Google alcanzando a open IA

Google anunció hace poco mañana el lanzamiento de Gemini, su modelo de lenguaje grande más grande y capaz hasta la fecha. A partir de hoy, el chatbot Bard de la compañía estará impulsado por una versión de Gemini y estará disponible en inglés en más de 170 países y territorios. Los desarrolladores y los clientes empresariales tendrán acceso a Gemini a través de la API la próxima semana, con una versión más avanzada que estará disponible el próximo año.

¿Qué tan bueno es Gemini? Google afirma que el rendimiento de su modelo más capaz «supera los resultados actuales de vanguardia en 30 de los 32 benchmarks académicos ampliamente utilizados en investigación y desarrollo de modelos de lenguaje grande». Gemini también obtuvo un 90.0% en una prueba conocida como «Comprensión del Lenguaje Multitarea Masiva» o MMLU, que evalúa capacidades en 57 temas que incluyen matemáticas, física, historia y medicina. Es el primer modelo de lenguaje grande que supera a expertos humanos en la prueba, según Google.

Gemini también parece ser un ingeniero de software muy competente. El año pasado, utilizando un modelo de lenguaje más antiguo, DeepMind presentó un sistema de IA llamado AlphaCode que superó al 54 por ciento de los codificadores humanos en competiciones de codificación. Utilizando Gemini, Google construyó una versión de próxima generación llamada AlphaCode 2. La secuela superó al 85 por ciento estimado de los humanos, según la compañía.

La codificación competitiva es significativamente diferente de la ingeniería de software diaria en algunos aspectos importantes: puede ser tanto más difícil como más fácil que lo que se le pide al ingeniero típico. Pero aún así, la tasa de progreso aquí es sorprendente.

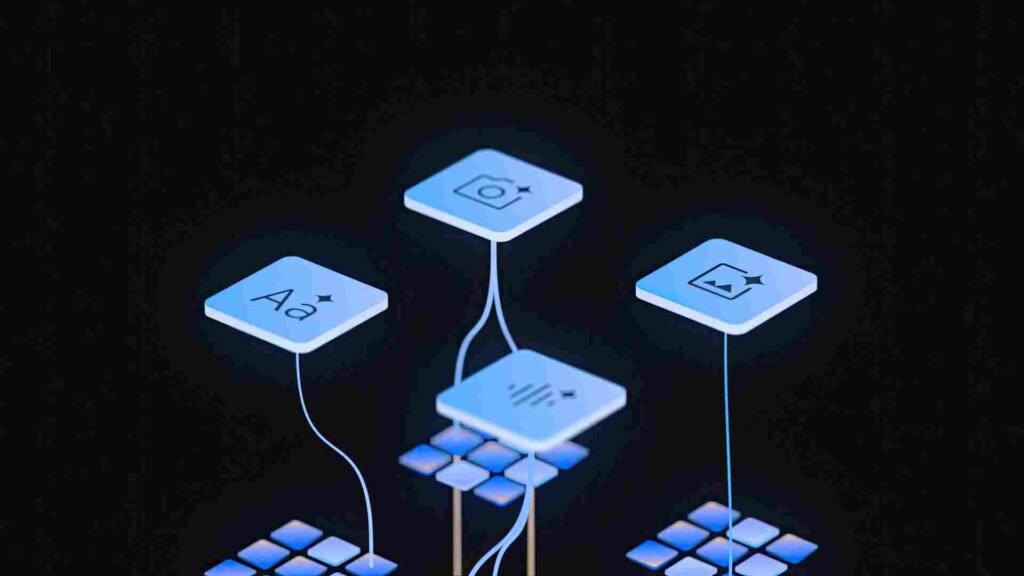

Gemini es nativamente multimodal, lo que significa que puede analizar el contenido de una imagen y responder preguntas al respecto, o crear una imagen a partir de una indicación de texto. Durante una sesión informativa el martes, un ejecutivo de Google cargó una foto de una tarea de matemáticas en la que el estudiante había mostrado sus cálculos que llevaban a la respuesta final. Gemini pudo identificar en qué paso del proceso del estudiante habían cometido un error, explicó su error y cómo responder correctamente la pregunta.

«Multimodal» puede sonar como un argot incómodo, pero el término aparece constantemente en la conversación con los ejecutivos de Google. La capacidad de los sistemas de IA para tomar diferentes tipos de datos (texto, imágenes, video, audio), analizarlos utilizando una sola herramienta y traducirlos dentro y fuera de varios formatos es el tipo de innovación fundamental que hace posible muchos otros progresos. (Todo esto es una manera larga de decir: lo siento por la cantidad de veces que aparece la palabra «multimodal» en la entrevista a continuación).

De acuerdo con la preferencia de Google por la marca caótica, Gemini estará disponible en tres «tamaños»: Nano, que es lo suficientemente pequeño como para caber en un teléfono inteligente y alimentará funciones en el teléfono inteligente Pixel 8 Pro a partir de hoy; Pro, que ahora alimenta a Bard; y Ultra, que comenzará a incorporarse a los productos el próximo año.

Sin haber utilizado ninguno de estos modelos, es difícil compararlos con los de rivales como OpenAI y Anthropic. Pero mi sentido básico es que Gemini Pro es mejor visto como la respuesta de la empresa a GPT-3.5 de OpenAI: en su publicación de blog de anuncio, la compañía señaló que Pro superó a GPT-3.5 en muchos, pero no todos, los desafíos de evaluación comparativa.

Eso configura a Ultra como el principal rival de GPT-4.5 Turbo para la corona del mejor modelo grande de lenguaje ampliamente disponible y de propósito general. Y Ultra no estará disponible el próximo año para que Google pueda completar las pruebas de confianza y seguridad.

Cuando esté disponible para los consumidores, Ultra alimentará un nuevo chatbot que la compañía llama Bard Advanced. Aunque la compañía no lo confirmó el martes, la marca me sugiere que Advanced podría ser la respuesta de Google a ChatGPT Plus: un producto de pago basado en suscripción para usuarios que desean el mejor producto disponible.

A partir de ahí, Google dice que Gemini comenzará a permeabilizar en todo el ecosistema de productos de consumo y empresariales de la compañía, comenzando con la búsqueda, Chrome, anuncios y sus aplicaciones de productividad.

Unas horas después de recibir información sobre las noticias, tuve la oportunidad de reunirme virtualmente con el CEO de Google, Sundar Pichai, y el cofundador y CEO de Google DeepMind, Demis Hassabis.

Fue mi primera oportunidad de hablar sobre el estado del arte en IA con Pichai desde marzo, cuando apareció en Hard Fork; y mi primera conversación con Hassabis. Durante más de 30 minutos, hablamos sobre las capacidades novedosas de Gemini, cómo la IA está cambiando la búsqueda y si Pichai cree que contratará a menos ingenieros de software el próximo año como resultado del progreso de la compañía.

A continuación, se presentan algunos aspectos destacados de la conversación; esta entrevista ha sido editada por claridad y longitud.

Casey Newton: Hoy compartieron una variedad de benchmarks de la industria que muestran el progreso que han logrado con Gemini. Pero me intriga su propia prueba personal de los modelos. ¿Qué están notando en ellos que les hace sentir que han dado un paso adelante?

Demis Hassabis: Creo que verás esto simplemente usando el nuevo Bard: la calidad en general ha mejorado masivamente respecto a nuestros modelos anteriores. Lo que me interesa específicamente es usarlo como asistente científico. Analizar realmente artículos científicos, los gráficos en esos artículos, interpretarlos. Colocar tablas en gráficos, extender gráficos. Lo que ha sido maravilloso